Google a développé TurboQuant, un algorithme de compression par intelligence artificielle qui peut réduire l’utilisation de la mémoire des modèles de langage de grande taille jusqu’à six fois

Google a développé un nouvel algorithme de compression appelé TurboQuant qui peut réduire considérablement les besoins en mémoire des grands modèles de langage. Selon les recherches publiées, TurboQuant peut compresser les modèles jusqu’à six fois tout en maintenant leur précision.

Les grands modèles de langage comme GPT-4 et Gemini nécessitent d’énormes quantités de mémoire pour fonctionner. Cette consommation de mémoire importante rend difficile et coûteux le déploiement de ces modèles sur des appareils à ressources limitées ou leur utilisation dans des applications à grande échelle.

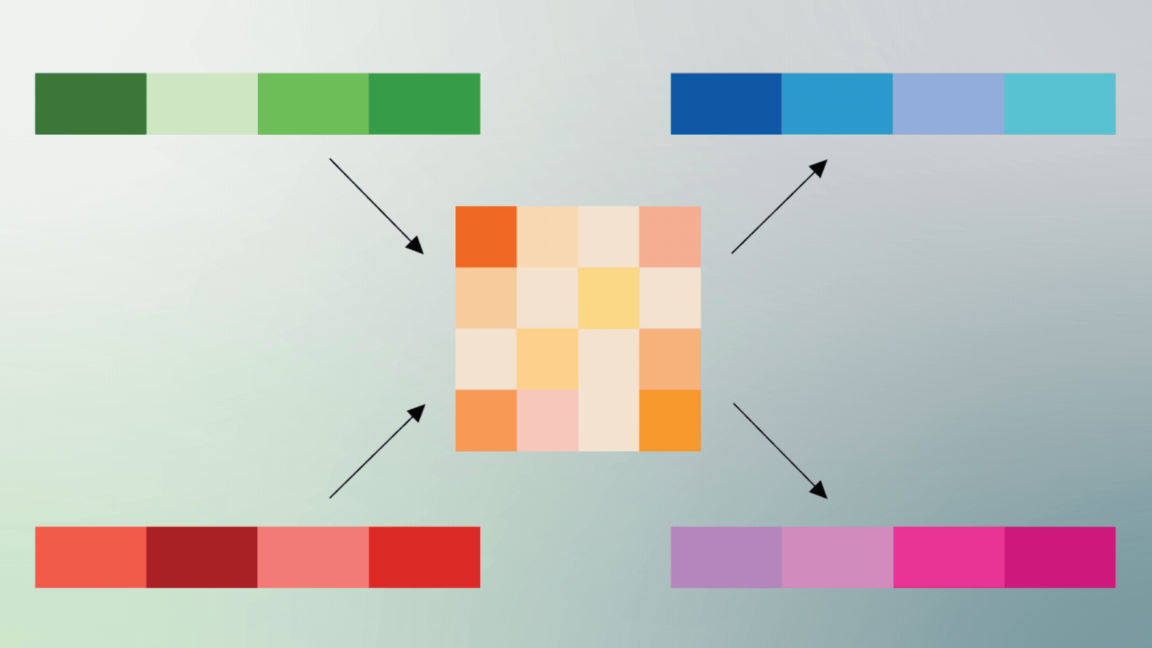

TurboQuant s’attaque à ce problème en utilisant une technique appelée quantification, qui réduit la précision des nombres utilisés pour représenter les paramètres du modèle. Au lieu de stocker chaque paramètre sous forme de nombre à virgule flottante de 16 bits, TurboQuant peut les représenter avec seulement 2 à 4 bits par paramètre.

Ce qui distingue TurboQuant des méthodes de quantification précédentes, c’est sa vitesse et son efficacité. L’algorithme peut compresser des modèles contenant des centaines de milliards de paramètres en quelques heures seulement, contre plusieurs jours pour les approches traditionnelles.

Les chercheurs ont testé TurboQuant sur plusieurs modèles de langage populaires, notamment Llama et Gemma. Dans tous les cas, l’algorithme a réussi à réduire considérablement l’utilisation de la mémoire tout en préservant les performances du modèle sur diverses tâches de traitement du langage naturel.

La compression des modèles de langage présente plusieurs avantages pratiques. Les modèles plus petits nécessitent moins de mémoire GPU, ce qui réduit les coûts d’infrastructure. Ils peuvent également fonctionner plus rapidement et être déployés sur un plus large éventail d’appareils, y compris les smartphones et les appareils périphériques.

Google a indiqué que TurboQuant pourrait contribuer à rendre les capacités d’IA avancées plus accessibles et plus abordables. La technologie pourrait permettre aux entreprises de déployer des modèles de langage sophistiqués sans avoir besoin d’investir dans du matériel coûteux.

Les chercheurs prévoient de publier le code de TurboQuant en open source, permettant ainsi à la communauté au sens large de l’IA de bénéficier de cette avancée. Cette décision s’inscrit dans la tendance croissante des grandes entreprises technologiques à partager leurs outils de recherche en IA avec le public.