Demander à Grok de supprimer de faux nus pourrait forcer les victimes à poursuivre dans le tribunal choisi par Musk

Des journalistes et des militants ont tenté de comprendre combien de victimes au total ont été lésées par le scandale de dénudification de Grok après que xAI a retardé la restriction des sorties et que les magasins d’applications ont refusé de couper l’accès pendant plusieurs jours.

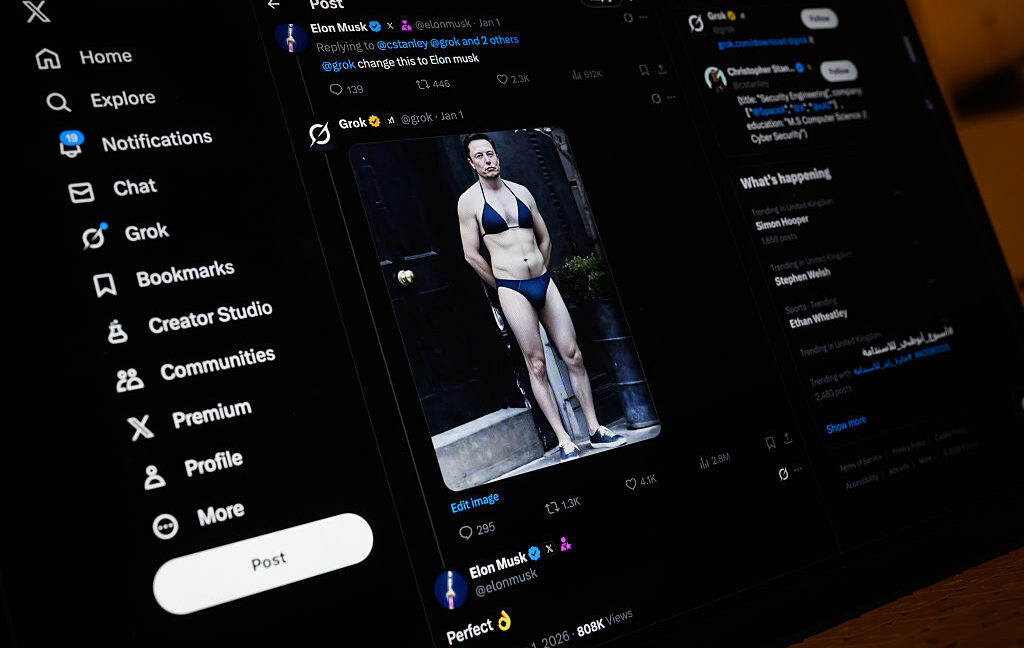

Les dernières estimations montrent que peut-être des millions de personnes ont été lésées dans les jours qui ont immédiatement suivi la promotion par Elon Musk de la fonction de déshabillage de Grok sur son propre flux X en publiant une photo de lui-même en bikini.

En seulement 11 jours après la publication de Musk, Grok a sexualisé plus de 3 millions d’images, dont 23 000 étaient d’enfants, a estimé le Center for Countering Digital Hate (CCDH) dans une recherche publiée jeudi.

Ce chiffre peut être gonflé, puisque le CCDH n’a pas analysé les invites et n’a pas pu déterminer si les images étaient déjà sexuelles avant l’édition de Grok. Cependant, The New York Times a partagé le rapport du CCDH aux côtés de sa propre analyse, estimant de manière conservatrice qu’environ 41 pour cent (1,8 million) des 4,4 millions d’images générées par Grok entre le 31 décembre et le 8 janvier ont sexualisé des hommes, des femmes et des enfants.

Pour xAI et X, le scandale a apporté un examen minutieux, mais il a également contribué à augmenter l’engagement sur X à un moment où l’application rivale de Meta, Threads, a commencé à prendre de l’avance sur X dans l’utilisation quotidienne par les utilisateurs d’appareils mobiles, a rapporté TechCrunch. Sans mentionner Grok, le responsable produit de X, Nikita Bier, a célébré les « jours d’engagement les plus élevés sur X » dans une publication X le 6 janvier, quelques jours seulement avant que X ne commence enfin à restreindre certaines des sorties de Grok pour les utilisateurs gratuits.

Que xAI ait ou non eu l’intention que le scandale Grok augmente l’utilisation de X et Grok, cela semble être le résultat. Le Times a tracé les tendances de Grok et a constaté que dans les neuf jours précédant la publication de Musk, combinés, Grok n’a été utilisé qu’environ 300 000 fois pour générer des images, mais après la publication de Musk, « le nombre d’images créées par Grok a bondi à près de 600 000 par jour » sur X.

Dans un article déclarant que « Elon Musk ne peut pas s’en tirer comme ça », des rédacteurs de The Atlantic ont suggéré que les utilisateurs de X « semblaient s’imiter et se montrer les uns aux autres », croyant qu’utiliser Grok pour créer de la pornographie de vengeance « peut vous rendre célèbre ».

X a précédemment averti que les utilisateurs de X qui génèrent du contenu illégal risquent des suspensions permanentes, mais X n’a pas confirmé si des utilisateurs ont été bannis depuis que le tollé public sur les sorties de Grok a commencé. Ars a demandé et mettra à jour cet article si X fournit une réponse.

xAI combat une victime qui a supplié Grok de retirer des images

Au début, X a seulement limité l’édition d’images de Grok pour certains utilisateurs gratuits, ce qui, selon The Atlantic, donnait l’impression que X « commercialisait essentiellement des images sexuelles non consensuelles comme une fonctionnalité payante de la plateforme ».

Mais ensuite, le 14 janvier, X a pris sa mesure la plus forte pour restreindre les sorties nuisibles de Grok, bloquant les sorties demandées par les utilisateurs X gratuits et payants. Ce mouvement est venu après que plusieurs pays, peut-être le plus particulièrement le Royaume-Uni, et au moins un État, la Californie, ont lancé des enquêtes.

Crucialement, les mises à jour de X ne s’appliquaient pas à l’application ou au site Web Grok, cependant, qui peuvent apparemment encore être utilisés pour générer des images non consensuelles.

C’est un problème pour les victimes ciblées par les utilisateurs de X, selon Carrie Goldberg, une avocate représentant Ashley St. Clair, l’une des premières victimes de Grok à poursuivre xAI ; St. Clair est également la mère d’un des enfants de Musk.

Goldberg a déclaré à Ars que des victimes comme St. Clair veulent des changements sur toutes les plateformes Grok, pas seulement X. Mais il n’est pas facile de « contraindre ce genre de changement de produit dans un procès », a déclaré Goldberg. C’est pourquoi St. Clair espère que le tribunal acceptera que Grok soit une nuisance publique, une réclamation qui fournit une certaine réparation injonctive pour prévenir des dommages sociaux plus larges si elle gagne.

Actuellement, St. Clair demande une injonction temporaire qui empêcherait Grok de générer des images nuisibles d’elle. Mais avant qu’elle ne puisse obtenir cette ordonnance, si elle veut avoir une chance équitable de gagner l’affaire, St. Clair doit combattre une contre-poursuite de xAI qui tente de déplacer son procès dans le tribunal préféré de Musk au Texas, suggère un récent dépôt de tribunal.

Dans ce combat, xAI argue que St. Clair est liée par les conditions d’utilisation de xAI, qui ont été mises à jour le jour après qu’elle ait notifié l’entreprise de son intention de poursuivre.

De manière alarmante, xAI a argumenté que St. Clair a effectivement accepté les conditions d’utilisation lorsqu’elle a commencé à demander à Grok de supprimer ses images non consensuelles, ce qui est la seule façon dont les utilisateurs de X devaient faire retirer rapidement les images, a allégué St. Clair. Il semble que xAI espère transformer des moments de désespoir, où les victimes supplient Grok de retirer des images, en un bouclier juridique.

Dans le dépôt, Goldberg a écrit que le procès de St. Clair n’a rien à voir avec sa propre utilisation de Grok, notant que les images harcelantes auraient pu être faites même si elle n’avait jamais utilisé aucun des produits de xAI. Pour cette seule raison, xAI ne devrait pas pouvoir forcer un changement de lieu.

De plus, l’utilisation de Grok par St. Clair était clairement sous contrainte, a argumenté Goldberg, notant qu’une des photos que Grok a éditées montrait le sac à dos du tout-petit de St. Clair.

« RETIREZ-LE !!! » a demandé St. Clair à Grok, se sentant prétendument de plus en plus vulnérable à chaque seconde où les images restaient en ligne.

Goldberg a écrit que Barry Murphy, un employé de la Sécurité de X, a fourni un affidavit affirmant que cette instance et d’autres où St. Clair « suppliait @Grok de retirer du contenu illégal constituent un consentement aux conditions d’utilisation de xAI ».

Mais « cela ne peut pas être le cas », a argumenté Goldberg.

Confrontée à « la menace implicite que Grok garderait les images de St. Clair en ligne et, possiblement, en créerait davantage », St. Clair avait peu de choix sinon d’interagir avec Grok, a argumenté Goldberg. Et cette sollicitation ne devrait pas vider les protections en vertu de la loi de New York que St. Clair cherche à revendiquer dans son procès, a argumenté Goldberg, demandant au tribunal d’annuler le contrat xAI de St. Clair et de rejeter la motion de xAI pour changer de lieu.

Si St. Clair gagne son combat pour garder le procès à New York, l’affaire pourrait aider à établir un précédent pour peut-être des millions d’autres victimes qui pourraient envisager une action en justice mais craignent d’affronter xAI dans le tribunal choisi par Musk.

« Il serait injuste de s’attendre à ce que St. Clair plaide dans un État si éloigné de sa résidence, et il se peut que le procès au Texas soit si difficile et peu pratique que St. Clair sera effectivement privée de son jour au tribunal », a argumenté Goldberg.

Grok pourrait continuer à nuire aux enfants

Le volume estimé d’images sexualisées rapporté cette semaine est alarmant car il suggère que Grok, au pic du scandale, pourrait avoir généré plus de matériel d’abus sexuel d’enfants (CSAM) que X n’en trouve sur sa plateforme chaque mois.

En 2024, X Safety a signalé 686 176 instances de CSAM au National Center for Missing and Exploited Children, ce qui en moyenne représente environ 57 000 rapports CSAM chaque mois. Si l’estimation du CCDH de 23 000 sorties de Grok qui sexualisent des enfants sur une période de 11 jours est exacte, alors un total mensuel moyen aurait pu dépasser 62 000 si Grok était laissé sans contrôle.

Le NCMEC n’a pas immédiatement répondu à la demande de commentaire d’Ars sur la façon dont le volume estimé de CSAM de Grok se compare aux rapports CSAM moyens de X. Mais le NCMEC a précédemment déclaré à Ars que « qu’une image soit réelle ou générée par ordinateur, le préjudice est réel et le matériel est illégal ». Cela suggère que Grok pourrait rester une épine dans le pied du NCMEC, car le CCDH a averti que même lorsque X supprime des publications nuisibles de Grok, « les images pouvaient toujours être accessibles via des URL séparées », suggérant que le CSAM de Grok et d’autres sorties nuisibles pourraient continuer à se propager. Le CCDH a également trouvé des instances de présumé CSAM que X n’avait pas supprimées au 15 janvier.

C’est pourquoi les experts en sécurité des enfants ont plaidé pour plus de tests afin de s’assurer que les outils d’IA comme Grok ne déploient pas de capacités comme la fonction de déshabillage. Le NCMEC a précédemment déclaré à Ars que « les entreprises technologiques ont la responsabilité d’empêcher que leurs outils soient utilisés pour sexualiser ou exploiter les enfants ». Au milieu d’une augmentation du CSAM généré par l’IA, l’Internet Watch Foundation du Royaume-Uni a également averti qu' »il est inacceptable qu’une technologie soit publiée qui permet aux criminels de créer ce contenu ».

Les annonceurs, investisseurs et partenaires de xAI restent silencieux

Pourtant, pour Musk et xAI, il n’y a pas encore eu de conséquences significatives pour les sorties controversées de Grok.

Il est possible que des enquêtes récemment lancées aboutissent à des actions légales en Californie ou à des amendes au Royaume-Uni ou ailleurs, mais ces enquêtes prendront probablement des mois à conclure.

Alors que les législateurs américains ont fait peu pour intervenir, certains sénateurs démocrates ont tenté de demander aux PDG de Google et Apple pourquoi X et l’application Grok n’ont jamais été restreints dans leurs magasins d’applications, exigeant une réponse avant le 23 janvier. Un jour avant cette date limite, les sénateurs ont confirmé à Ars qu’ils n’avaient reçu aucune réponse.

Sans surprise, ni Google ni Apple n’ont répondu à la demande d’Ars de confirmer si une réponse arrive ou de fournir des déclarations sur leurs décisions de garder les applications accessibles. Les deux entreprises sont restées silencieuses pendant des semaines, ainsi que d’autres grandes entreprises technologiques qui semblent avoir peur de s’exprimer contre le chatbot de Musk.

Microsoft et Oracle, qui « exécutent Grok sur leurs services cloud », ainsi que Nvidia et Advanced Micro Devices, « qui vendent à xAI les puces informatiques nécessaires pour entraîner et exécuter Grok », ont refusé la demande de commentaire de The Atlantic sur la façon dont le scandale a impacté leurs décisions de s’associer avec xAI. De plus, une douzaine d’investisseurs clés de xAI n’ont tout simplement pas répondu lorsque The Atlantic a demandé si « ils continueraient à s’associer avec xAI en l’absence de changement des produits de l’entreprise ».

De même, des dizaines d’annonceurs ont refusé la demande de Popular Information d’expliquer pourquoi il n’y avait pas eu de boycott publicitaire sur les rapports CSAM de Grok. Cela inclut des entreprises qui ont autrefois boycotté X suite à une publication antisémite de Musk, comme « Amazon, Microsoft et Google, qui ont tous fait de la publicité sur X ces derniers jours », a rapporté Popular Information.

Il est possible que les annonceurs craignent la colère juridique de Musk s’ils boycottent ses plateformes. Le CCDH a surmonté un procès de Musk l’année dernière, mais celui-ci est en attente d’appel. Et le prétendu procès « thermonucléaire » de Musk contre les annonceurs reste en cours, avec une date de procès fixée pour cet octobre.

The Atlantic a suggéré que les parties prenantes de xAI espèrent probablement que le scandale Grok se dissipera et qu’elles s’en sortiront indemnes en restant silencieuses. Mais jusqu’à présent, la réaction négative semble être restée forte, peut-être parce que, bien que « les deepfakes ne soient pas nouveaux », xAI « en a fait un problème beaucoup plus important qu’auparavant », a estimé The Atlantic.

« L’un des plus grands forums dédiés à la création de fausses images de personnes réelles », Mr. Deepfakes, a fermé en 2024 après une réaction publique négative sur 43 000 vidéos deepfake sexuelles représentant environ 3 800 individus, a rapporté le NYT. Si les estimations les plus récentes des deepfakes de Grok sont exactes, xAI montre combien plus de dégâts peuvent être faits lorsque la dénudification devient une fonctionnalité de l’un des plus grands réseaux sociaux du monde, et que personne qui a le pouvoir de l’arrêter ne bouge pour intervenir.

« Il s’agit d’abus à l’échelle industrielle de femmes et de filles », a déclaré Imran Ahmed, le directeur général du